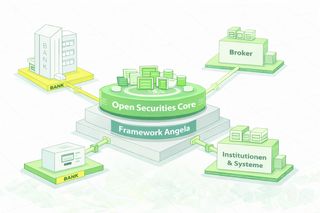

Die Abwicklungsplattform für Wertpapiere

DISACON CORE basiert auf dem Framework Angela, einer Eigenentwicklung der DISACON AG, das auf bewährten Open-Source- und Cloud-Technologien aufsetzt, die gezielt ausgewählt wurden, um Betriebssicherheit, Wartbarkeit und langfristige Integrationsfähigkeit sicherzustellen.

Transaktionen & Abwicklung

Verarbeitung von Geschäftsvorfällen aus angebundenen Handels- und Ordersystemen. Validierung, Anreicherung und Übergabe an nachgelagerte Prozesse.

Clearing & Settlement

Steuerung von Clearing- und Settlement-Prozessen inklusive Statusverfolgung, Fristen und Ausnahmen (inkl. definierter Reprocessing-Pfade).

Bestandsführung & Corporate Actions

Regelbasierte Verarbeitung von Kapitalmaßnahmen und Folgeprozessen auf Bestände; Auswirkungen auf Bestände und Buchungen sind nachvollziehbar dokumentiert.

Steuerliche & regulatorische Prozesse

Abbildung steuerlicher Logiken und regulatorischer Anforderungen entlang der Prozesskette. Varianten werden über konfigurierbare Regeln und Parameter abgebildet.

Backoffice & Operations

Operative Workflows zur Recherche und Ausnahmebehandlung. Ziel ist eine konsistente Sicht auf Prozesse, Zustände und Bearbeitungsstände – fachlich wie technisch.

Plattformidee & Architekturprinzipien

DISACON CORE ist so entworfen, dass fachliche Logik über Jahre stabil betreibbar bleibt, Änderungen kontrolliert eingeführt werden können und Verarbeitungsschritte jederzeit belegbar sind.

Prinzip: Trennung der Verantwortlichkeiten

Fachliche Regeln, Prozessorchestrierung, Datenhaltung und Integration sind bewusst entkoppelt. Dadurch können Änderungen in einer Ebene eingeführt werden, ohne die gesamte Plattform zu destabilisieren.

- Fachlogik: Domänenregeln, Validierungen, Ausnahmen

- Technik: Verarbeitung, Persistenz, Observability

- Integration: Adapter, APIs, Events, Batch-Anbindungen

- Betrieb: Deployment, Skalierung, Security, Compliance

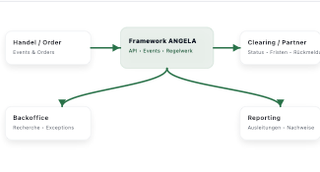

Prinzip: Ereignis- und regelbasierte Verarbeitung

Prozesse werden als Ketten nachvollziehbarer Verarbeitungsschritte modelliert. Auslöser können Ereignisse (z. B. Statusänderungen), Zeitfenster (Batch) oder externe Rückmeldungen (Clearing/Settlement, Verwahrstelle) sein.

- Event-getrieben: asynchrone Verarbeitung und lose Kopplung

- Batch-fähig: Verarbeitung in definierten Zeitfenstern (z. B. Tagesläufe)

- Regelbasiert: fachliche Varianten ohne tiefgreifende Codeänderungen

Prinzip: Auditierbarkeit und Reproduzierbarkeit

Für regulierte Prozesse ist entscheidend, dass Ergebnisse erklärbar sind. DISACON CORE zielt darauf ab, jeden Verarbeitungsschritt fachlich und technisch belegbar zu machen (Audit-Trail), inklusive der jeweils verwendeten Regeln, Eingangsparameter und relevanten Zustandsänderungen.

Dadurch sind Analysen, Fehlerbehebung, Nachweise und langfristige Historienauswertungen möglich – auch über längere Zeiträume.

Technische Module

Die technische Architektur stellt sicher, dass fachliche Logik skalierbar, nachvollziehbar und betrieblich stabil umgesetzt wird.

Processing Engine (Orchestrierung)

Verarbeitung wird als Folge deterministischer Schritte modelliert. Jeder Schritt hat definierte Eingaben, Ausgaben und Fehlerpfade.

- Schrittketten (Pipelines) statt ad-hoc Logik

- Idempotenz für robuste Wiederholungen

- Explizite Ausnahme- und Reprocessing-Pfade

Rule Engine (fachliche Varianten)

Regeln und Varianten werden nachvollziehbar gepflegt und versioniert. Änderungen sind kontrolliert ausrollbar und eindeutig Ergebnissen zuordenbar.

- Regelversionierung & Freigabeprozesse

- Regelkontext (Gültigkeit, Institution, Produkt, Zeit)

- Transparente Auswertung (Begründbarkeit)

Event & Data Layer (Persistenz)

Zustände, Bewegungen und Statusänderungen werden konsistent persistiert. Historisierung ermöglicht Rückverfolgung, Reproduktion und Langzeitauswertungen.

- Transaktionale Persistenz für konsistente Ergebnisse

- Historie und Korrelation über Prozesse hinweg

- Audit-Trail für Nachweise und Revisionsfragen

Integration Layer (Schnittstellen & Adapter)

Integration über APIs, Events oder dateibasierte Verfahren. Adapter entkoppeln kundenspezifische Formate vom Kern.

- API- und Event-basierte Integration

- Batch-/File-Schnittstellen bei Bedarf

- Adapterkonzept für proprietäre Formate

Observability & Audit

Monitoring von Durchsatz, Latenzen und Fehlerraten sowie eine fachliche Prozesssicht (Korrelation) unterstützen Betrieb, Reconciliation und Nachweise.

- Monitoring und Alerting

- Fachliche und technische Protokollierung

- Audit-Trail für Untersuchungen und Revision

Engineering-Prinzip: KI-unterstützte Umsetzung

Wir nutzen KI gezielt als Werkzeug zur Unterstützung in Entwicklung, Dokumentation und Testautomatisierung. So beschleunigen wir Delivery und Qualitätssicherung.

- Frontend & UI: Unterstützung bei Komponentenentwicklung und Wiederverwendbarkeit

- Dokumentation: schnellere Erstellung und konsistente technische Beschreibungen

- Tests: KI-gestützte Generierung und Erweiterung von Testfällen

- Qualität: höhere Testabdeckung und stabilere Releases bei kurzen Iterationszyklen

Integration

DISACON CORE integriert sich in bestehende Systemlandschaften. Typisch ist eine stufenweise Einführung pro Prozess oder Produktbereich, ergänzt um kontrollierte Migration und Reconciliation.

Typische Umsysteme

- OMS / Handel: Ordererzeugung, Routing, Ausführung

- Kernbank / Kundenverwaltung: Kundenstammdaten, Kontenlogik

- Verwahrstellen: Settlement, Bestandsbestätigungen, Corporate Actions

- Reporting: regulatorische und betriebliche Reports

- Data/BI: DWH, Analytics, Langzeitauswertungen

Einführungsmuster

- Parallelbetrieb: Koexistenz für definierte Zeiträume

- Schrittweise Migration: Einführung entlang klarer Prozessschnitte

- Kontrollierte Umschaltung: Cutover mit Nachweis- und Reconciliation-Phasen

Das Integrationskonzept trennt kundenspezifische Formate von Kernprozessen. Dadurch bleibt die Plattform wartbar, auch wenn sich Umsysteme ändern.

DISACON CORE wird als offener Kern in bestehende Systemlandschaften integriert: Handel/Order liefert Events, nachgelagerte Systeme konsumieren Status-Updates, Belege und fachliche Ausleitungen.

Systeme & Datenflüsse

Integrationsprinzipien

Lose Kopplung über Events, stabile APIs für synchronen Zugriff und klare Versionierung für Partneranbindungen. Fachliche Entscheidungen erfolgen über Regelwerk/Parameter statt via Hardcoding.

Audit & Reprocessing

Statuswechsel, Fristen und Ausnahmen werden als nachvollziehbare Verarbeitungsschritte modelliert. Reprocessing-Pfade sind explizit, sodass Korrekturen reproduzierbar und prüfbar bleiben.

Betrieb & Cloud-Architektur

Die Plattform ist für den Betrieb in Cloud-Umgebungen ausgelegt. Architekturentscheidungen berücksichtigen Skalierung, Security, klare Verantwortlichkeiten sowie den Nachweisbetrieb in regulierten Kontexten.

Betrieblich relevante Eigenschaften

- Skalierung: horizontale Skalierung von Verarbeitungskomponenten

- Resilienz: entkoppelte Komponenten, robuste Wiederholbarkeit, kontrollierte Fehlerpfade

- Mandantenfähigkeit: Trennung von Daten, Konfiguration und Betriebsparametern

- Security: minimale Rechte, Segmentierung, nachvollziehbare Änderungen

Deployment- und Betriebsmodelle

Je nach Organisation sind verschiedene Modelle möglich – vom vollständigen Betrieb bis zu gemeinsamem oder eigenverantwortlichem Betrieb mit Unterstützung.

- Managed Operation: Betrieb durch DISACON inkl. Monitoring, Updates, Security

- Enablement Operation: Eigenbetrieb ganz/teilweise, DISACON unterstützt Setup und Betrieb

AWS-Architektur (abstrahiert)

Die AWS-Zielarchitektur trennt Processing, Persistenz, Integration und Observability. Konkrete AWS-Services hängen vom Setup (Mandantentrennung, Netzsegmentierung, Security-Anforderungen) ab.

- Netz & Segmente: klare Trennung von öffentlichen/privaten Bereichen

- Compute: skalierbare Workloads für Verarbeitung

- Daten: konsistente Persistenz und Historisierung

- Observability: Metriken, Logs, Traces, fachliche Korrelation

Umgebungen

DISACON CORE wird über getrennte Umgebungen betrieben, um Änderungen kontrolliert zu testen und Releases sicher in die Produktion zu überführen.

- Trennung nach Stages: separate Accounts/Namespaces für DEV, UAT und PROD

- Release-Mechanik: promoted Artefakte (Builds) statt manueller Eingriffe

- Nachvollziehbarkeit: klare Versionierung und reproduzierbare Deployments

- Stabilität: minimiertes Risiko durch kontrollierte Übergänge zwischen Umgebungen

Übersicht der zentralen Architekturbausteine und Cloud-Infrastruktur: Systemzuschnitt, Plattformkern, Datenhaltung, Anbindung externer Systeme sowie AWS-Betrieb inkl. CI/CD, Security und Nachvollziehbarkeit.

Wie ist das System grundsätzlich geschnitten?

Welche fachlichen Module deckt der Plattformkern ab?

- Konto Management

- Depot Management

- Order Management

- Zahlungsabwicklung

- Wertpapierabwicklung

- Steuern und Regulatorik

- Reporting

- Backoffice Operations

Öffentlich zeigen wir die Capability-Sicht. Die interne Service-Zerlegung ist Teil der technischen Dokumentation.

Was ist das Framework Angela?

Welche Daten werden wo gehalten?

Wie werden externe Systeme angebunden?

Konkrete Feldmappings und Partnerformate sind projektspezifisch und werden in der Implementierungsdokumentation geführt.

Welche Nutzergruppen und Clients gibt es?

Wie sieht die AWS-Cloud-Infrastruktur aus?

Wie läuft CI/CD und Deployment (mehrere AWS-Accounts)?

Details wie konkrete Pipeline-Stages, Branch-Policies und Deployment-Strategien sind je Umgebung konfiguriert.

Wie werden Sicherheit und Nachvollziehbarkeit adressiert?

- Ingress über definierte Gateways (CDN, API Gateway, Load Balancer)

- Authentifizierung/Autorisierung über OIDC/IAM

- Historisierung und Korrelation von Verarbeitungsschritten für Auditierbarkeit

- Monitoring/Logging und Archivierung (CloudWatch, S3 Log Archive)

Kundenspezifisch: Mandantentrennung, Verschlüsselung (KMS), Backup/DR, Netzsegmente und Security Controls.

Lässt sich die Lösung effizient skalieren?

Unsere Architektur ermöglicht eine stufenweise Skalierung von bis zu 10.000 % bei gleichbleibenden Grundkosten. Große Volumina zu planbaren Kosten – ohne Kostenexplosion bei Wachstum.

Warum Erlang?

Erlang ist speziell für hochverfügbare, fehlertolerante und skalierbare Systeme entwickelt – ursprünglich im Telekommunikationsumfeld, wo Milliarden von Nachrichten in Echtzeit verarbeitet werden. Diese Eigenschaften sind entscheidend für maximale Zuverlässigkeit.

Wieso Business-Logik direkt in der Datenbank?

Durch die zentrale Logik unmittelbar in der Datenbank vermeiden wir komplexe Middleware, reduzieren Fehlerquellen und beschleunigen die Verarbeitung erheblich. Das Ergebnis: nachvollziehbare Prozesse und maximale Performance ohne unnötige Zwischenschichten.

Handelt es sich um erprobte Technologien?

Wir setzen auf eine bewährte Architektur mit modernen Technologie-Stacks, die sich bereits in hochsensiblen Anwendungen wie WhatsApp oder Klarna erfolgreich bewährt haben.

Wie ist die Performance bei steigenden Volumina?

Selbst bei Millionen von Assets pro Tag beträgt die Verarbeitungszeit pro Transaktion nur 10 Millisekunden – auch im Hochlastbetrieb.

Ist DISACON CORE an einen bestimmten Cloud-Anbieter gebunden?

DISACON CORE wird cloudbasiert auf Hyperscaler-Infrastruktur betrieben. Die Plattform ist so gestaltet, dass der Betrieb perspektivisch auch in Multi-Cloud- oder Rechenzentrumsumgebungen umgesetzt werden kann, ohne den Kern der Lösung zu ersetzen.

Ist die Steuerberechnung in DISACON CORE integriert?

Ja. DISACON CORE bildet die steuerliche Verarbeitung von Kapitalerträgen für den deutschen Markt integriert ab. Die Steuerlogik ist Teil der Prozesskette und kann damit direkt in die End-to-End-Abwicklung eingebunden werden.

Kann ein externer Steuerkern angebunden werden (z. B. SECTRAS)?

Ja, grundsätzlich ist das möglich. DISACON CORE kann so integriert werden, dass eine externe Steuerlogik – beispielsweise SECTRAS von cpb – als Bestandteil der End-to-End-Prozesskette genutzt wird. Dazu wurden bereits vertiefte fachliche und technische Abstimmungen durchgeführt, wie sich ein externer Steuerkern sauber in die bestehende Prozesslogik einbinden lässt. Eine produktive Anbindung ist dabei typischerweise ein separates Integrationsvorhaben.

Gibt es eine Zertifizierung für das System?

Ja. Aktuell befinden wir uns gemeinsam mit Deloitte in einem Projekt zur Durchführung einer IT-Prüfung nach IDW PS 860 mit Schwerpunkt auf den GoBD-Anforderungen für das Framework Angela der Abwicklungsplattform DISACON CORE. Der Abschluss der Prüfung und die Bereitstellung des Prüfungsberichts werden derzeit für Ende des ersten Quartals (Q1) erwartet

Wie erfolgt die Mandantentrennung bei DISACON CORE?

Die Mandantentrennung erfolgt bei DISACON auf Infrastruktur-Ebene. Jeder Mandant erhält eine vollständig getrennte Betriebsumgebung mit klarer technischer Isolation. Durch den Cloud-Betrieb ist diese Trennung besonders effizient und kostengünstig umsetzbar. Die Bereitstellung erfolgt vollautomatisch über Infrastructure as Code, wodurch neue Mandantenumgebungen schnell, sicher und standardisiert ausgeliefert und betrieben werden können.

Ist der Betrieb als Depotbank möglich?

Ja. DISACON CORE kann auch im Umfeld einer Depotbank eingesetzt werden. Die Plattform unterstützt die erforderlichen Prozesse und Integrationen, um depotbankspezifische Anforderungen abzubilden und den Betrieb in einer entsprechenden Rollenverteilung zu ermöglichen.

Ist ein White-Label-Betrieb möglich?

White-Label befindet sich auf der Roadmap von DISACON und ermöglicht den Betrieb mehrerer Mandanten mit eigenem Haftungsdach. Kunden werden dabei in separaten Umgebungen mit eigener Datenhaltung betrieben, wodurch vollständige Datenisolierung, hohe Performance und revisionssichere Audit-Prozesse sichergestellt werden.

Ein White-Label-Betrieb für Mandanten ohne eigenes Haftungsdach ist grundsätzlich möglich und kann im Rahmen eines individuellen Projekts realisiert werden. Derzeit ist dies jedoch nicht als Standard vorgesehen.

Technologie Stack

DISACON CORE basiert auf etablierten Technologien und bewährten Tools. Der folgende Auszug zeigt die wichtigsten Bausteine; die Auswahl folgt dem Ziel, Betriebssicherheit, Wartbarkeit und Integrationsfähigkeit langfristig sicherzustellen.

Konsistente relationale Datenhaltung für Geschäftsdaten, Historie und Auswertungen.

Parallele Verarbeitung großer Datenmengen für stabile und robuste Services.

Einheitliche, standardisierte API-Beschreibung als Grundlage stabiler Integrationen.

Moderne Frontend-Entwicklung für stabile, wiederverwendbare UI-Komponenten.

Cloud-Infrastruktur und Betriebsgrundlage für skalierbare Deployments, Security und Observability.

Transparenz statt Lock-in

Der Stack ist so gewählt, dass Plattformbetrieb und Weiterentwicklung planbar bleiben: klare Schnittstellen, nachvollziehbare Änderungen und die Möglichkeit, den Betrieb auch in anderen Cloud- oder Rechenzentrumsumgebungen umzusetzen, ohne den Gesamtkern zu ersetzen.

Amazon Web Services, AWS und die entsprechenden Logos sind Marken von Amazon.com, Inc. oder ihrer verbundenen Unternehmen. Alle genannten Marken und Logos sind Eigentum ihrer jeweiligen Rechteinhaber und dienen ausschließlich der Beschreibung der eingesetzten Technologien.